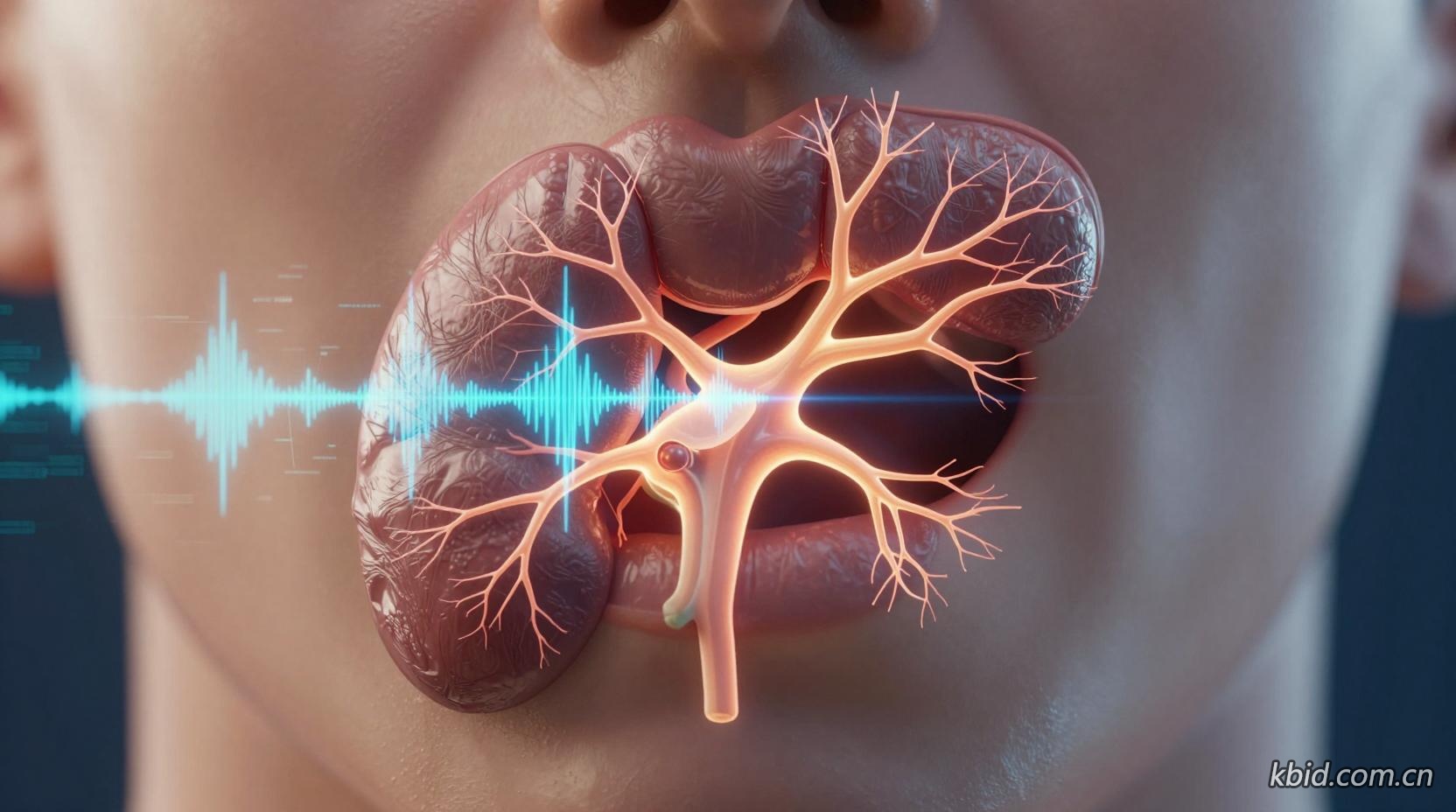

当一段合成语音让你无法分辨其真伪时,背后往往是深度学习技术在精准操控每个声学细节。声音克隆技术从早期的拼接合成发展到如今的端到端生成,其核心突破在于深度神经网络对声音特征的解耦与重建能力。

声音的数字解剖学

基于WaveNet的生成模型改变了游戏规则。它不再依赖传统的参数合成,而是直接对原始音频波形进行建模。该架构使用扩张卷积网络,能捕捉长达数秒的音频上下文关系,每秒24000个采样点的建模精度让合成语音的细微颤动和气息声都得以保留。

说话人特征的数学分离

真正精妙之处在于模型如何将说话人身份特征与语音内容解耦。通过对比学习,系统会构建一个说话人嵌入空间,每个人的声音特征都被映射为128维或256维的向量。这个向量就像声音的DNA,包含了音色、共振峰分布、语速偏好等个性特征,而与具体说话内容完全无关。

从文本到语音的精准控制

现代语音克隆系统通常采用双阶段训练策略。第一阶段在数千小时的多说话人数据上预训练,让模型掌握通用的语音生成规律;第二阶段仅需目标说话人几分钟的语音,通过微调就能适配特定音色。这种设计让个性化语音合成不再需要海量数据,原本需要专业录音棚数小时的工作,现在一段电话录音就能完成。

情感韵律的神经网络建模

高保真克隆的终极挑战在于情感表达。最新研究开始引入韵律编码器,专门分析语音中的音高曲线、能量变化和时长pattern。结合注意力机制,模型能学习到不同语境下的韵律模式,比如疑问句尾音的自然上扬,或者强调重音的恰当处理。这种细粒度控制让合成语音不再是单调的文本朗读,而是带有情感温度的语音表达。

随着扩散模型在音频领域的应用,声音克隆的保真度正在逼近物理极限。不过有趣的是,技术越成熟,我们越需要思考如何在这些几乎完美的复制品中保留那些让人类声音独一无二的不完美特质。

评论(8)

128维向量这个比喻挺形象

这个比喻确实好懂

电话录音就能训练?那隐私问题咋解决

扩散模型具体怎么提升保真度的?求科普

克隆声音能用来干嘛?有点好奇

可以玩配音,挺有意思的

之前试过类似工具,克隆出来的声音总带机械感

这技术要是能克隆我偶像的声音就好了🤔