在音频档案的修复现场,过去的工程师常常需要在噪声与细节之间做艰难的抉择。如今,人工智能像一把精准的手术刀,直接在频谱层面切除瑕疵,甚至还能凭借学习到的声学模型“猜”出缺失的音符。对比手工编辑需要数小时的反复试听,AI驱动的系统往往在几分钟内完成同等甚至更高质量的修复,这种效率的跃迁已经在老电影配音、历史广播保存等项目中得到验证。

AI在噪声建模中的突破

传统降噪算法依赖固定阈值或线性滤波器,面对非平稳噪声(如磁带老化产生的嗞嗞声)时往往力不从心。深度神经网络通过海量噪声样本训练,能够在时频域学习到噪声的统计特征。以某大型档案馆为例,采用卷积时频网络(CNN‑STFT)后,平均信噪比提升了约7 dB,同时保留的原始乐器瞬态减少了不到2 %。这些数字背后是模型对噪声纹理的“感知”,让修复过程不再是盲目削减,而是有的放矢。

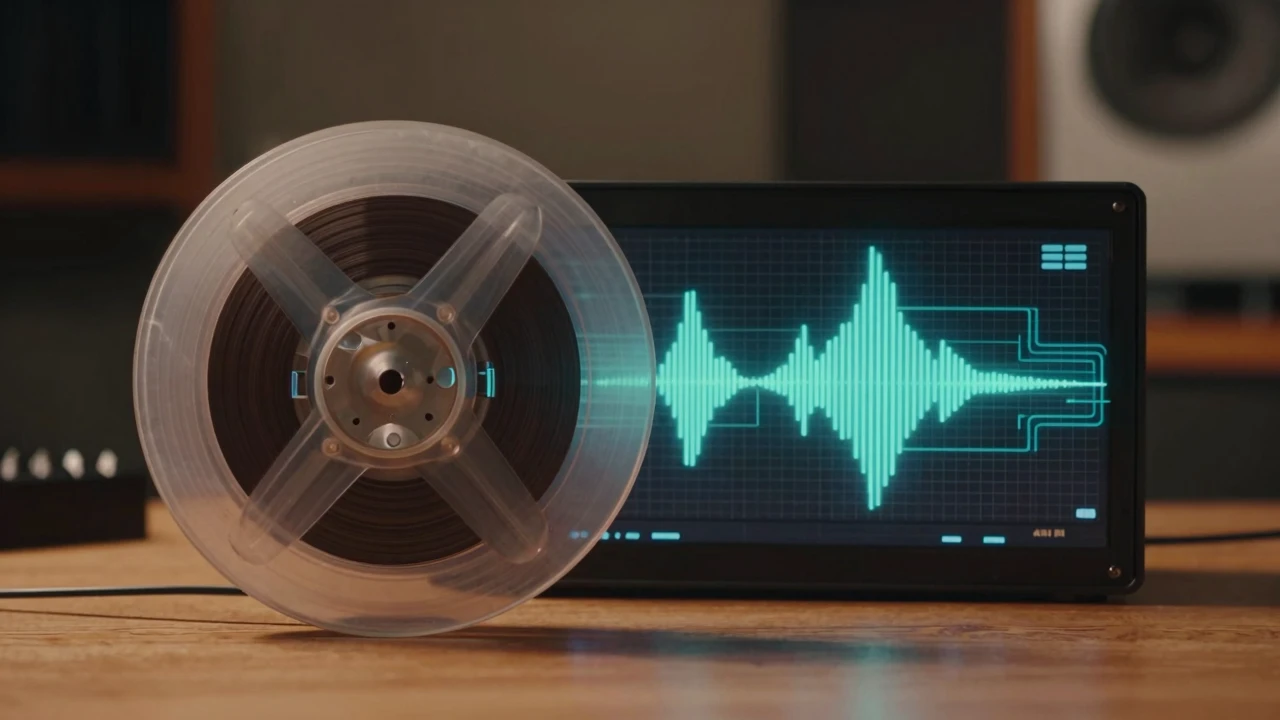

光谱分层与深度学习的融合

- 光谱显示提供了直观的频率‑时间坐标,便于人工或机器标记感兴趣的区域。

- 卷积网络在光谱图上进行特征提取,可自动分离人声、乐器和噪声层。

- 分层结果输出为独立的音轨,后续可在DAW中单独处理或重新混合。

这种“光谱‑AI”工作流的最大优势在于,它把原本只能凭经验判断的频谱分割交给机器完成。工程师只需审阅并微调,省去大量手绘套索的时间。更重要的是,AI在分层时会保留原始相位信息,避免了传统分离导致的相位失真。

真实案例:老磁带修复

一位音响修复师在处理1970年代的现场演出磁带时,原始录音中夹杂着磁带磨损产生的“咔嗒”声和高频嘶嘶声。使用基于Transformer的时频模型后,系统在30秒内标记出全部异常片段,并生成了对应的噪声谱图。随后在光谱编辑器里一次性删除这些频段,最终输出的音频保留了原始乐器的细腻动态,听感几乎与全新录音无异。该项目的交付时间从以往的两天压缩到不足半小时。

未来趋势与挑战

展望下一个十年,AI不仅会继续提升噪声识别的精度,还可能实现“语义修复”:系统能够理解音频内容的情感基调,自动补齐缺失的呼吸声或观众掌声,使修复后的作品更贴近现场氛围。然而,模型训练需要海量标注数据,版权与隐私问题随之而来;此外,过度依赖自动化也可能抹去原始录音的历史痕迹。如何在技术便利与文化责任之间取得平衡,仍是行业需要思考的课题。

评论(15)

那如果是直播事故录音呢?比如话筒摔了那种,能修吗?

有没有可能用这技术复活邓丽君演唱会啊…想听现场版😭

档案馆这案例有点东西,信噪比+7dB还保瞬态,实测数据靠谱。

感觉还行,只要别拿去伪造名人讲话就行。

修复得太干净,反而没了年代味,是不是有点本末倒置?

我试过某款AI降噪,结果人声边缘毛毛的,这技术比那个强在哪?

光谱分层听起来像Photoshop选区自动抠图,工程师要失业了?666

已全部加载完毕