说起混合合成技术,很多人可能立刻联想到那些功能繁复、界面花哨的现代软件合成器,觉得它无非是把几种老技术打包在一起。但如果你拆开这个“黑盒子”,会发现它的核心逻辑远非简单叠加,而是一种基于“声音对象”与“信号流”的模块化哲学。它的目标,不是让用户记住十几种合成引擎的名字,而是提供一个统一的框架,让任何声音生成和处理的方法都能在此对话、融合,并最终服务于一个统一的、超越单一方法的声音设计目标。

从“加法”到“乘法”的思维跃迁

传统合成器,无论是减法、加法还是频率调制(FM),其架构通常是线性的、预设的。你沿着一条既定的信号路径工作。混合合成的革命性在于,它将这些线性的“链”打散,变成了可自由连接、并行处理的“节点”或“模块”。

- 核心单元:振荡器与处理器不再是固定角色。在混合架构中,一个物理建模引擎的输出,可以立即被送入一个波表振荡器作为其波形来源;而一个经过粒子处理的采样片段,其动态频谱又可以反过来调制一个加法合成引擎的谐波振幅。这里没有“主”与“从”的严格区分,任何模块都可以成为信号源,也可以成为调制器或处理器。

- 统一的数据与调制总线:这是混合合成得以实现的“胶水”。无论是模拟式的连续电压,还是数字式的MIDI、OSC数据,在混合合成环境里都被抽象为统一的调制信号。这意味着,你可以用一段采样经过分析得到的包络,去控制一个FM算符的指数;也可以用物理建模弦的振动频率,来驱动一个粒状云在音高空间里散步。调制路径的无限可能性,让不同合成范式产生了化学反应。

混合的实质:在解构与重构中创造新维度

那么,把不同的声音生成方法“混”在一起,到底是为了什么?答案并非为了复杂而复杂,而是为了突破单一合成方法固有的音色“维度限制”。

举个例子,减法合成擅长塑造平滑的频谱轮廓,但在表现动态的、非谐波的纹理细节时往往乏力。波表合成能提供丰富的谐波变化,但声音的“实体感”和自然衰减特性可能不如物理建模。混合合成允许你同时获取多个维度的优势:用一个物理建模引擎生成声音的核心“躯体”和自然鸣响特性,同时用一个波表振荡器为其“镀上”一层随着力度变化的复杂谐波色彩,再用一个粒子处理器为声音的起振部分添加一些随机的、闪烁的微观粒子。

这种组合,本质上是在解构声音的物理和心理声学属性,并用量身定制的最佳工具去分别构建它们,最后在统一的时空和调制框架下重构为一个有机整体。最终的声音,既不是纯物理的,也不是纯数字的;它可能同时具备模拟滤波的温润、FM的金属质感以及采样的真实片段感。这种音色的“杂交”优势,是任何单一技术路径都难以企及的。

半模块化环境:自由与精度的平衡术

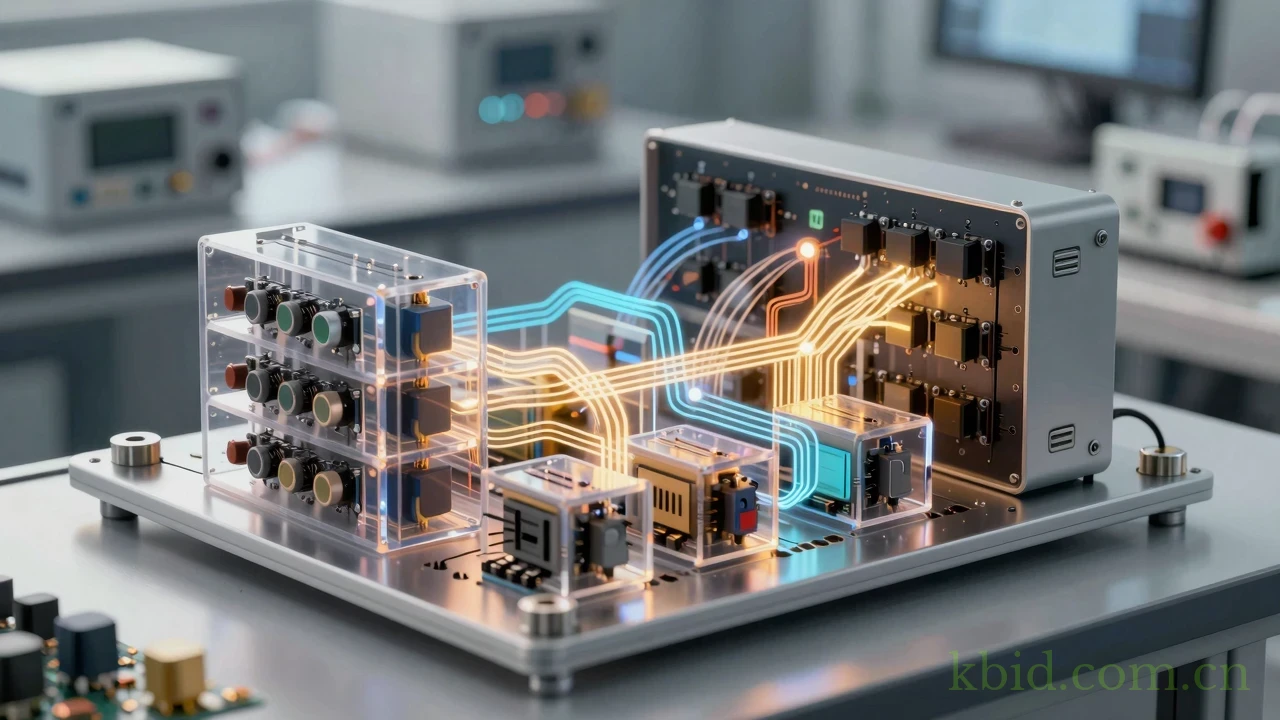

为了实现这种自由,现代混合合成器(如UVI Falcon、Reaktor、Vital等)普遍采用了“半模块化”或“节点式”的架构。它不像纯模块合成(如VCV Rack)那样需要从零开始接线,给予了用户一组功能强大、预先封装好的“超级模块”(如一个完整的加法合成器、一个带多种算法的粒子引擎),同时保留了用虚拟“线缆”或调制矩阵在它们之间创建复杂交互关系的能力。

这种设计哲学的精妙之处在于,它降低了系统级设计的门槛,却无限拔高了声音设计的上限。用户无需从最基本的VCO、VCF开始搭建一个物理建模器,可以直接使用现成的、高度优化的建模模块;但同时,他完全可以把这个模块的输出,引入到一个他自己用脚本编写的、自定义的频谱处理节点中。脚本和用户调制系统的加入,更是将控制权从“选择预设”延伸到了“定义行为逻辑”,让混合合成从静态的音色库,变成了动态的、可交互的“声音有机体”生成器。

所以,下次当你加载一个混合合成器,面对琳琅满目的引擎列表时,不妨换个思路:你不是在选择一种合成方法,而是在为一个即将诞生的声音宇宙,挑选最合适的物理定律和化学元素。那些振荡器、采样器、效果器,都是等待被你组合的“原子”,而调制系统和信号流,就是让它们发生核聚变、释放巨大声音能量的反应炉。

评论(15)

看完更迷糊了,有没有更简单的解释?

半模块化确实平衡了自由度和上手难度

感觉更适合专业音效设计,做普通音乐有点杀鸡用牛刀

物理建模加波表再粒子处理…这组合出来的音色得啥样啊

这种节点式设计比传统线性合成灵活多了

振荡器和处理器角色可以互换?有点意思

之前用Falcon折腾过一阵子,确实功能强大但学习曲线陡峭

这玩意儿听起来好复杂啊🤔

已全部加载完毕